In un recente articolo pubblicato su Nature (nella sezione Perspectives) Lisa Messeri, antropologa della Yale University e Molly Crockett, neuroscienziata alla Princeton University, attraverso l’analisi di oltre un centinaio di recenti pubblicazioni sul potenziale dell’IA nella ricerca scientifica (considerando sia IA generativa sia predittiva), hanno individuato 4 tipologie di figure immaginarie dell’IA: l’oracolo, il surrogato, l’analista e il giudice.

ORACOLO

Interviene nella fase di design della ricerca per risolvere il problema dell’eccesso di pubblicazioni scientifiche, effettuando la ricerca bibliografica, offrendo sintesi e valutazioni della letteratura di riferimento e generando nuove ipotesi di ricerca. In questo compito l’IA sarebbe più precisa, esaustiva, meno soggetta a bias e instancabile, rispetto alle capacità umane.

SURROGATO

Interviene nella fase di raccolta dei dati, generando in modo accurato e pratico datapoint surrogati da sistemi naturali complessi. Questi dati sintetici sarebbero i surrogati di quei dati che sono difficili o dispendiosi da ottenere (per esempio strutture cosmologiche, immagini mediche, sequenze di acidi nucleici e comportamenti umani) e servono per migliorare la robustezza delle generalizzazioni e la varietà dei dati.

ANALISTA

Interviene nella fase di analisi dei dati per risolvere il problema della vastità e della complessità dei dati che eccedono le nostre capacità analitiche. Per esempio l’IA come analista potrebbe occuparsi della catalogazione, delle annotazioni e anche dell’attribuzione di significato a testi, immagini e dati qualitativi, nelle scienze sociali; annotazioni automatiche di tipi di cellule o funzioni proteiche. Estrae rappresentazioni significative dai dati, semplici e accessibili ma con una perdita di informazione minima. Inoltre l’IA sarebbe in grado di scoprire nei dati caratteristiche valide a scopi predittivi, ma inaccessibili alla mente umana.

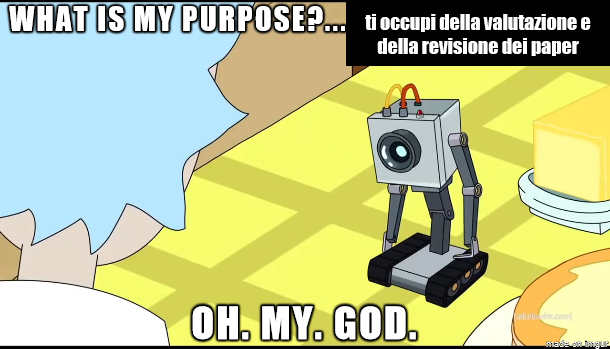

GIUDICE

Interviene nella fase di peer review per lo screening dei manoscritti sottomessi, automaticamente identifica anche se si tratta di studi duplicati, giudica la qualità dello studio e la riproducibilità dei risultati in maniera più oggettiva rispetto ai revisori umani.

In queste visioni del futuro della ricerca, l’IA diventa più di uno strumento: un vero e proprio partner di ricerca che entra nel team quasi come soggetto autonomo, un super-ricercatore che rende più efficienti e oggettive le diverse fasi, rimpiazzando il lavoro umano percepito nei suoi limiti di tempo, attenzione, capacità analitiche e scarsa oggettività.

L’eccessivo entusiasmo in queste soluzioni però ha i suoi rischi, come spiegano gli autori della ricerca:

“Per illustrare la natura di questi rischi, ci rifacciamo alla metafora della monocoltura. In agricoltura, per monocoltura si intende la pratica di coltivare una sola specie in un campo. Questa pratica migliora l’efficienza ma rende la coltura più vulnerabile a parassiti e malattie. L’ efficienza offerta dagli strumenti di intelligenza artificiale può favorire la crescita di monocolture scientifiche, in cui alcune forme di produzione di conoscenza dominano su tutte le altre. Può avvenire in due modi distinti ma complementari: in primo luogo, dando priorità ai tipi di domande e ai metodi più adatti all’utilizzo dell’IA (monoculture del sapere); e in secondo luogo, dando priorità al tipo di punto di vista che l’IA è in grado di esprimere (monoculture di conoscitori). Proprio come le monocolture di piante sono più vulnerabili ai parassiti e alle malattie, le monocolture scientifiche rendono la nostra comprensione del mondo più vulnerabile all’errore, alla parzialità e al rischio di perdere opportunità di innovazione“.

Le autrici classificano i diversi tipi di rischio epistemico della “monocultura”:

- L’illusione della profondità esplicativa è un’illusione di comprensione in cui qualcuno crede erroneamente di avere un livello di comprensione più profondo o più completo di quello che ha in realtà.

- L’illusione dell’ampiezza esplorativa è un’illusione di comprensione che accompagna le monoculture del sapere in cui gli scienziati credono erroneamente di esplorare l’intero spazio delle ipotesi testabili, mentre in realtà stanno esplorando uno spazio più ristretto di ipotesi testabili con gli strumenti dell’IA.

- L’illusione dell’oggettività è un’illusione di comprensione che accompagna una monocultura del sapere in cui gli scienziati credono falsamente che gli strumenti di IA non abbiano un punto di vista o siano in grado di rappresentare tutti i punti di vista possibili, mentre gli strumenti di IA incorporano in realtà i punti di vista dei loro dati di addestramento e degli sviluppatori

Le illusioni di comprensione sono una categoria di errori metacognitivi che derivano dall’avere convinzioni errate sulla natura della propria comprensione.

In pratica i ricercatori potrebbero erroneamente credere che gli strumenti di intelligenza artificiale facciano progredire la comprensione scientifica, senza rendersi conto che questi strumenti invece restringono il campo di produzione della conoscenza scientifica stessa, riducono la varietà dei punti di vista, del tipo di disciplina e dell’argomento di ricerca. L’interdisciplinarità della ricerca e una formazione non solo tecnica ma anche basata sulle scienze sociali, l’epistemologia e la filosofia della scienza, possono essere strumenti utili per cogliere e limitare i rischi epistemici nelle diverse fasi che prevedono l’integrazione di strumenti di IA.

Secondo le autrici è importante considerare fin da subito non le potenzialità dell’IA e i limiti tecnici, ma anche come questa possa influire sulle pratiche sociali di produzione della conoscenza.

“Bisogna valutare questi rischi ora, mentre le applicazioni dell’IA sono ancora in fase nascente, perché saranno molto più difficili da affrontare se gli strumenti dell’IA saranno profondamente integrati nel processo della ricerca”.

Per approfondire

- MESSERI, Lisa; CROCKETT, M. J. Artificial intelligence and illusions of understanding in scientific research. Nature, 2024, 627.8002: 49-58. (articolo a pagamento)

- https://www.nature.com/articles/d41586-024-00639-y